دیپ فیک چیست؟ معرفی تکنولوژی Deepfakes

بررسی پدیده دیپ فیک؛ آشنایی با سازوکار، تاریخچه، کاربردهای مخرب و غیرمخرب و راهکارهای تشخیص و مقابله با deepfakes.

در میانهی سال ۲۰۲۳، خطرات و مزایای هوش مصنوعی به یکی از گفتمانهای داغ در دنیا تبدیل شده است. یکی از نگرانیهای منتقدان AI، پدیدهی دیپ فیک (Deepfake) است. تکنولوژیای که از آن برای تولید محتوای فیک یا غیرواقعی اما بسیار متقاعدکننده یا بهتر بگوییم، فریبنده استفاده میشود.

آشنایی با خطرات و پتانسیلهای تکنولوژیهای جدید برای زندگی در دنیای آینده ضروری است. به همین دلیل در این مقاله، سازوکار دیپ فیک را بررسی کرده و موارد استفادهی مفید و غیرمخرب از آن را معرفی خواهیم کرد. در ادامه روشهای تشخیص و مقابله با آن را نیز مرور میکنیم. با ما همراه شده و با یکی از چالشهای زندگی دیجیتال در سالهای آینده آشنا شوید.

تاریخچه دیپ فیک

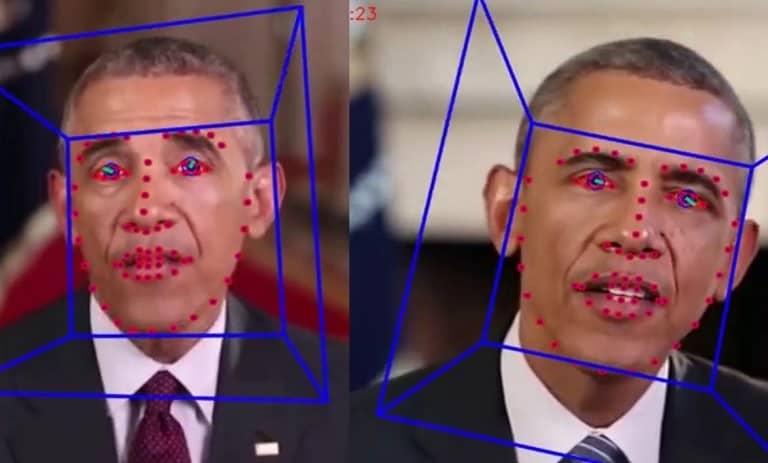

بسیاری، منشا دیپ فیک را برنامههایی مانند فتوشاپ میدانند. تکنولوژی GAN نیز ابتدا در سال ۲۰۱۴ در دانشگاه مونترال توسط محققی به نام Ian Goodfellow توسعه یافت. اما برای اولین بار در سال ۲۰۱۷ بود که کاربری ناشناس با عنوان Deepfake با استفاده از GAN، ویدیوهایی جعلی از سلبریتیها در وبسایت Reddit منتشر کرد. غیر از زاکربرگ، تاکنون افراد مشهور دیگری مانند باراک اوباما، ایلان ماسک، سم بنکمن فراید (مدیر سابق صرافی FTX) و دها سلبریتی، هدف تولیدکنندگان محتواهای سوءاستفادهگرانهی اینچنینی بودهاند.

دیپ فیک و نحوه کار آن

دیپ فیک، نوعی الگوریتم تولید محتوای جعلی بر اساس دادههای ماشین لرنینگ، دیپ لرنینگ و شبکههای عصبی با هدف جعل صدا و تصویر افراد برای بیان مطلب دلخواه است. محتوایی ساختگی که به اعتبار چهره و صدای افراد، واقعی و قابلاعتماد جلوه میکند. اهداف مخرب پشت پردهی چنین فایلهای دیجیتالی عموما کلاهبرداری، اخاذی، تحریف اذهان عمومی با انگیزههای سیاسی، مالی و حتی شخصی است.

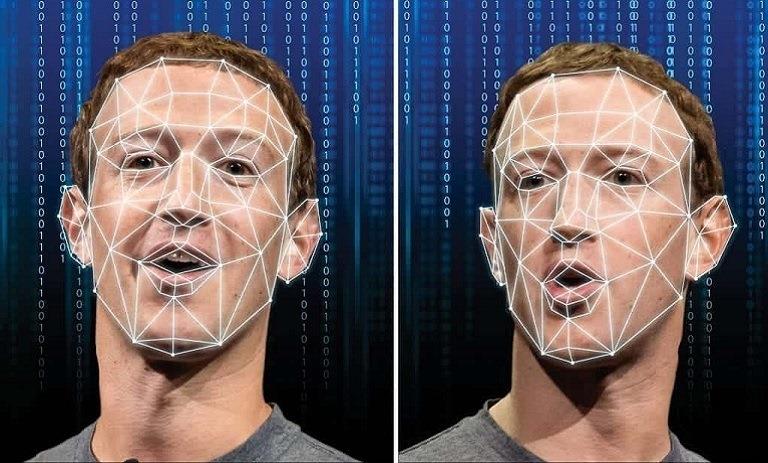

شاید شما هم ویدیوی معروف مارک زاکربرگ که در آن در حال اعتراف به سوءاستفادهی فیسبوک از کاربرانش است را دیده باشید. این دقیقا همان کاری است که دیپ فیک انجام میدهد. تولید چنین ویدیوهایی به کمک اپلیکیشنهایی مانند Zao، DeepFace Lab، FakeApp و Face Swap انجام میشود. در گیت هاب نیز پروژههای زیادی با هدف تولید چنین برنامههایی ایجاد شده است. در ادامه منطق این فناوری و سازوکار تولید محتوا به این روش را شرح میدهیم.

الگوریتم های دیپ فیک

تکنولوژی Deepfakes از دو الگوریتم به نامهای مولد (Generator) و تمایز (Discriminator) برای تولید و سپس بهبود محتوای جعلی استفاده میکند. تولید فایل اولیه بر اساس مجموعهای از دادههای آموزشی دیجیتال، برعهده Generator است. پس از آن Discriminator با مطابقت نسخهی اولیه با نمونههای واقعی، مرتبا آن را اصلاح میکند.

شبکه متخاصم GAN

هر خروجی الگوریتم تمایز به دادههای تغذیهکنندهی مولد اضافه شده تا دوباره بهعنوان دادهی اولیه استفاده شود. بهاینترتیب، سازوکاری به نام شبکهی متخاصم مولد یا GAN بهوجود میآید که از Deep Learning برای تشخیص الگوها در تصویر و صوت واقعی استفاده میکند. بهعنوان مثال، شبکهی GAN، یک ویدیوی واقعی از فرد موردنظر را از زوایای مختلف مشاهده میکند. سپس با استفاده از یک رمزگذار خودکار (Autoencoder) مبتنی بر Neural Network، حالات چهره، زبان بدن و ژستهای او را شناسایی یا رمزگذاری (Encoding) میکند. در ادامه، ویژگیهای جمعآوریشده به ویدیوی جعلی با استفاده از Decoder اعمال میشود.

سازوکار ذکرشده، امکان تولید ویدیوهای کاملا ساختگی یا ترکیبی با نگاشتن صدا و تصویر افراد به جای یکدیگر را فراهم میکند. در برخی موارد نیز با استفاده از تکنیکهای همگامسازی لب، صدای ضبطشده به ویدیوی فرد دیگر اعمال و حرکات لب او بهگونهای اجرا میشود که گویی در حال گفتن همان کلمات است. اگر صدا مربوط به خود فرد باشد، فریبندگی ویدیو بیشتر میشود. از دیپ فیک برای تولید متن نیز استفاده میشود. گاهی هدف از این کار، تولید متنهایی با سبک نگارشی فردی خاص است.

خطرات Deepfakes و موارد استفاده غیرقانونی از آن

تکنولوژی دیپ فیک تاکنون مورد سوءاستفادهی بسیاری از افراد سودجو، کلاهبرداران سازمانی و حتی قدرتهای سیاسی بوده است. مهمترین خطرات این فناوری را در ادامه بررسی میکنیم.

نقض کپی رایت

دیپ فیک فرصتی برای تولیدکنندههای غیرواقعی و سودجو در عرصههایی مانند موسیقی، نقاشیهای دیجیتال و ویدیوآرت، است که با دستمایه قراردادن اثر هنری افراد دیگر، به تولید آثار تقلبی بپردازند. اگرچه پیگیری این آثار در کشورهای توسعهیافته نسبتا آسان است، اما بازار هنرمندان را در کشورهای درحالتوسعه را تهدید میکند.

خطرات خاص Deepfake برای بازارهای مالی

در دنیای اقتصاد نیز تکنولوژی دیپ فیک با اهداف خرابکارانه استفاده میشود. یکی از مهمترین آنها، مربوط به احراز هویت در ارز دیجیتال است. فرآیندی که طی آن، کاربران صرافیهای متمرکز باید با ارائهی عکس از خود هویتشان را در پلتفرم موردنظر ثبت کنند. با Deepfakes امکان جعل هویت افراد حقیقی بیشتر میشود.

علاوهبراین، در بازار سهام نیز ویدیوهای غیرواقعی مدیران یک شرکت میتواند سبب افزایش قیمت یا کاهش قیمت سهام همان شرکت شود. تصاویر جعلی، مبنی بر حمایت افراد سرشناس از یک ارز دیجیتال سبب تغییرات قیمت غیرواقعی در بازار به نفع پروژههای دیگر میشود.

همچنین دیپ فیک میتواند ابزاری عالی برای اسکم باشد. ویدیوهای جعلی که در آنها ظاهرا مدیر یک شبکه، صرافی و یا فردی شناختهشده در حال تبلیغ یک ICO یا طرحهای تشویقی خاص است، تاکنون ضررهای مالی هنگفتی برای کاربران در پی داشتهاند.

اخاذی، انتقام گیری و سوءاستفاده از اعتبار

دیپ فیک یکی از ابزارهای جدی برای اخاذی از افراد، انتقامگیری دیجیتال یا سوءاستفاده از اعتبار اشخاص است. سودجویان، چهرهی فرد را روی ویدیویی قرار میدهند که ممکن است برای او دردسرساز شود و اعتبارش در معرض خطر قرار گیرد. حتی ممکن است فرد را در حال بیان جملاتی نشان دهد که برای او هزینههای مالی، شغلی و اجتماعی در پی دارد.

تولید مدارک جعلی

فایلهای صوتی و تصویری در بسیاری از دادگاهها بهعنوان مدرک اثبات بیگناهی یا گناهکاری افراد استفاده میشوند. فایلهای دیپ فیک تولیدشده توسط متهم، شاکیان، شهود یا حتی کاربران عادی اینترنت میتوانند سبب تصمیمگیریهای اشتباه از سوی قضات شوند. از سوی دیگر، مدارک جعلی میتوانند برای بهدستآوردن اطلاعاتی مانند شمارهحساب شخصی، اعتباری یا دریافت تسهیلات مالی استفاده شوند.

تحریف اذهان عمومی

استفاده از ویدیوهای deepfake برای سیاستمداران نیز دردسرساز شده است. در برخی موارد، محتواهای ساختگی، موازنهی قدرت را بین احزاب سیاسی و کشورها، حداقل برای مدتی کوتاه تغییر داده است. برخی از آنها اعتبار افراد را هدف داده و برخی دیگر به دنبال کسب اعتبار برای گروههای سیاسی هستند.

موارد استفاده قانونی از دیپ فیک

درست است که محتواهای تولیدشده با Deepfake اساسا غیرواقعی هستند اما این تکنولوژی موارد استفاده قانونی هم دارد. ازجمله مهمترین آنها موارد زیر هستند:

- تولید صدا و تصویر از افراد معروف برای بازیهای ویدیویی

- صداسازی در صنعت سینما برای صحنههای خاص و شبیهسازیشده

- تولید تصویر از مناظر یا لوکیشنهای ساختگی در صنعت سینما

- ساخت و توسعه برنامههای کاربردی پشتیبانی مشتریان

- برنامههای پاسخ به تماس مشتریان

چطور یک محتوای جعلی را تشخیص دهیم؟

امروزه بیش از هر زمان دیگری باید در مواجهه با محتواهای دیجیتال هشیار باشیم. یک کلیک اشتباه روی لینکی مخرب میتواند سبب آلودگی دستگاه دیجیتال ما به انواع بدافزار شده یا سرمایهمان را به غارت ببرد. توجه به چند نکتهی زیر میتواند تشخیص فایلهای تولیدشده با برنامههای دیپ فیک را آسانتر کند.

کیفیت تصویر در محتوای جعلی

در ویدیوها به دنبال نقاط مبهم، تار یا بلورشده بگردید. آیا درخشندگی چهرهی فرد بهخصوص مرز بین سر و صورت و محیط او با نور اطراف او هماهنگی دارد؟ بزرگنمایی غیرمعمول یا ناهماهنگ نیز نشانهای از محتوای جعلی است. همچنین ممکن است متوجه شوید نور دو قسمت مختلف ویدیو با هم سازگار نیست که نشان میدهد از دو ویدیوی متفاوت استفاده شده است.

حرکات غیرطبیعی و ناهماهنگ

آیا سرعت صدا و تصویر یکی است؟ آیا حرکات لب گوینده با سرعت ادای کلمات هماهنگ است؟ دراینصورت و اگر موضوع محتوا نیز مشکوک و غیرمعمول است، باید احتمال دیپ فیک را جدی بگیرید. همچنین حرکات صورت بهخصوص چشمها و لبها را زیر داشته باشید.

بیان غیرطبیعی

دقت کنید که طرز بیان حروف و کلمات طبیعی باشد. آیا گاهی صدای فرد اصطلاحا کامپیوتری میشود؟ یا با لحن و بیانی که همیشه از او دیده بودید متفاوت است؟ کلمات و جملات غیرمنطقی، نشانهای از ویدیوهای دیپ فیک هستند. در بسیاری از این محتواها در میانهی صحبت، نوشته یا عکس بهیکباره، مطلبی بیربط عنوان شده یا مخاطب به کلیک یا انجام عملی تشویق میشود.

اعتبار منبع محتوا

در مواجهه با هر خبری بهویژه آنهایی که شما را تشویق به انجام عملی خاص مانند کلیک روی لینک یا شرکت در قرعهکشی و غیره میکنند، باید اعتبارسنجی منبع انجام دهید. آیا در رسانههای دیگر هم از آن محتوا استفاده شده یا به موضوع آن پرداخته شده است؟ چه رسانهای آن را تهیه کرده است؟ آیا مطلب بیانشده اساسا منطقی است؟ به لینکها و آدرسهای ایمیل نیز مشکوک باشید.

مقابله با دیپ فیک؛ تکنولوژی در برابر تکنولوژی

اپلیکیشنها و الگوریتمهای تولید محتوای جعلی روزبهروز پیشرفتهتر میشوند اما از سوی دیگر، شرکتها و نهادهای امنیت سایبری نیز روی مقابله موثر با آنها تمرکز کردهاند. کنسرسیومی نیز با نام CFDC در آمریکا با مشارکت فیسبوک، مایکروسافت و چند دانشگاه برجسته برای توسعه راهحلهای شناسایی محتواهای تولیدشده با AI از فایلهای اصیل تشکیل شده است. در ادامه، دو روش مهم مقابله با پدیده دیپ فیک را معرفی میکنیم.

بلاکچین؛ روشی برای اعتبارسنجی محتوا

فناوری بلاکچین، میتواند منبع ویدیوها و اصالت آنها را پیش از انتشار در شبکههای اجتماعی بررسی کند. در حال حاضر، فیسبوک و توییتر از این روش استفاده میکنند. همچنین پروژهی فایل کوین نیز با همین هدف ایجاد شده است. در این شبکه، هر قطعه از محتوای دیجیتال در یک شبکهی غیرمتمرکز برچسب زمانی (Timestamp) خورده، تایید و ذخیره میشود. بهاینترتیب، فایل غیرقابلدستکاری و قابلردیابی خواهد شد. بنابراین، میتوان اصالت هر محتوا را در فایل کوین سنجید. فرایندی که به آن هش محتوا گفته میشود.

ابزارهای تشخیص دیپ فیک

تاکنون شرکتهای فناوری، راهحلهایی برای مقابله با محتواهای جعلی و شناسایی آنها ارائه کردهاند. مهمترین آنها، Adobe، Microsoft، Operation Minerva و Sensity هستند. بهعنوان مثال، ابزار Adobe به کاربر محصولات این برند، اجازه میدهد که با استفاده از یک امضای دیجیتال، فایلش را منحصربهفرد و برای تولید محتواهای فیک، غیرقابلاستفاده کند. سه شرکت دیگر نیز سیستمهایی برای شناسایی دیپ فیک با استفاده از بانک اسناد جعلی شناساییشده یا امتیازدهی اصالت محتوا دارند. این راهحلها نیز مبتنی بر AI هستند.

تیغ دو لبه هوش مصنوعی

دنیای امروز با تکنولوژیهای جدید و پتانسیلهای خوب و بد فراوانی مواجه است. آنها بهسرعت رشد میکنند اما دولتها هنوز نمیدانند چطور برایشان قانونگذاری کنند. درحالیکه بهنظر میرسد توسعهدهندههای فناوری پشت Deepfake، تنها به مزایای آن فکر میکردهاند، این تکنولوژی، امروزه بیشتر به یک تهدید بدل شده است. تهدیدی که افراد عادی تا سلبریتیها و سیاستمداران را نشانه میگیرد.

در حال حاضر تنها روش مصون ماندن از مخاطرات محتواهای جعلی، افزایش هشیاری و پرهیز از تصمیمگیری عجولانه در برابر فایلهای دیجیتالی است که حتی ظاهرشان بسیار صادقانه و اصیل بهنظر میرسد. نظر شما دربارهی خطرات دیپ فیک چیست؟ آیا هوش مصنوعی خود میتواند راهحلی برای آن داشته باشد؟

اولین نفری باشید که نظر خود را به اشتراک میگذارید!

اولین نفری باشید که نظر خود را به اشتراک میگذارید!

قیمت بیت کوین BTC

قیمت بیت کوین BTC قیمت اتریوم ETH

قیمت اتریوم ETH قیمت بایننس کوین BNB

قیمت بایننس کوین BNB قیمت تتر USDT

قیمت تتر USDT قیمت نات کوین NOT

قیمت نات کوین NOT قیمت پکس گلد PAXG

قیمت پکس گلد PAXG قیمت کاردانو ADA

قیمت کاردانو ADA قیمت پولکادات DOT

قیمت پولکادات DOT قیمت ترون TRX

قیمت ترون TRX قیمت ریپل XRP

قیمت ریپل XRP قیمت سولانا SOL

قیمت سولانا SOL قیمت اوالانچ AVAX

قیمت اوالانچ AVAX قیمت آربیتروم ARB

قیمت آربیتروم ARB قیمت پپه PEPE

قیمت پپه PEPE قیمت تون کوین TON

قیمت تون کوین TON